Video je uznemirujuć. Dvojica muškaraca prijetećeg izgleda stoje pokraj bijelog kombija u polju i u rukama drže daljinske upravljače, piše Guardian.

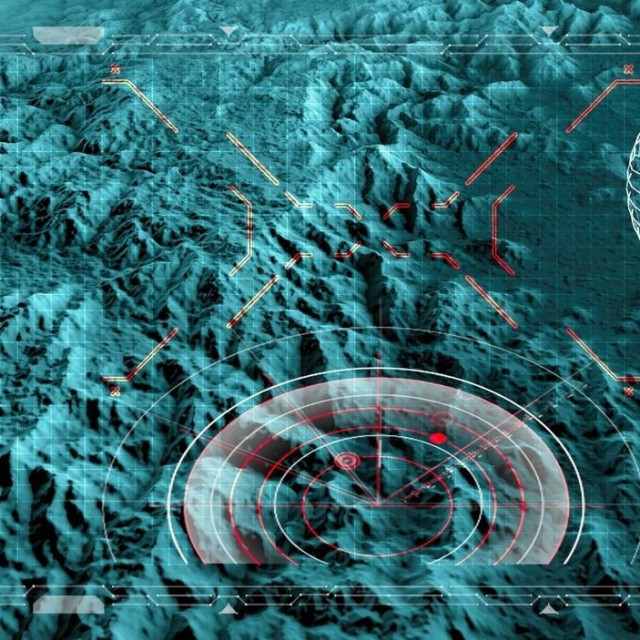

Otvaraju stražnja vrata kombija, a zvukovi quadcopter dronova se pojačavaju. Pritisnu prekidač i dronovi se roje poput šišmiša iz špilje. Za nekoliko sekundi stižu do učionice fakulteta. Roboti ubojice upadaju kroz prozore i sve druge otvore. Studenti vrište od užasa, zarobljeni unutra, dok dronovi napadaju smrtonosnom silom. Lekcija koju film Slaughterbots pokušava prenijeti je jasna: sićušni roboti ubojice su već ovdje ili udaljeni tek mali tehnološki korak naprijed. Teroristi bi ih lako mogli upotrijebiti. A postojeća obrana je slaba ili je uopće nema.

Neki vojni stručnjaci tvrde da je Slaughterbots - film koji je k...

Za sudjelovanje u komentarima je potrebna prijava, odnosno registracija ako još nemaš korisnički profil....